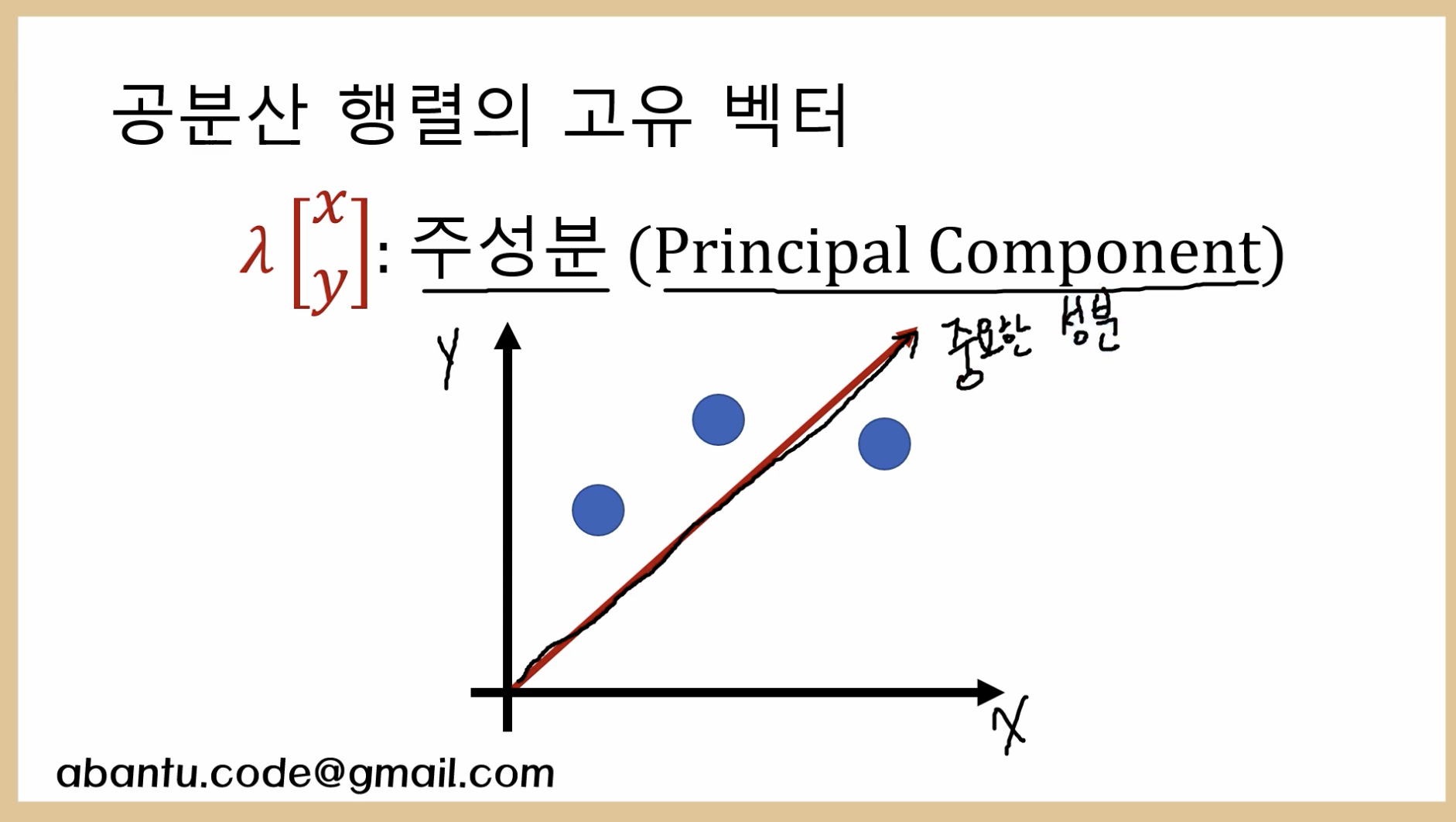

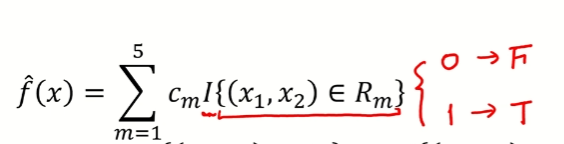

주성분 분석(PCA: Principal Component Analysis) 인공지능에서 오버피팅을 없애주는 가장 확실한 방법 아반투님의 동영상을 캡쳐하며 정리한 내용입니다. (추천) https://www.youtube.com/watch?v=lhRmMjgXwW0 PC(principal component) : 고유값 람다에 고유벡터를 곱한 실수배$$ PC score(1st PC에 사영시킨 값)는 내적을 하면 구할 수 있음! PCA의 의미 1. 차원축소 ( 보통 차원이 줄면 overfitting 문제가 해결이 됨 ) 2. z(호감) = w1(가중치)x(외모) + w2(가중치)y(성격)로 새로운 변수를 생성할 수 있음